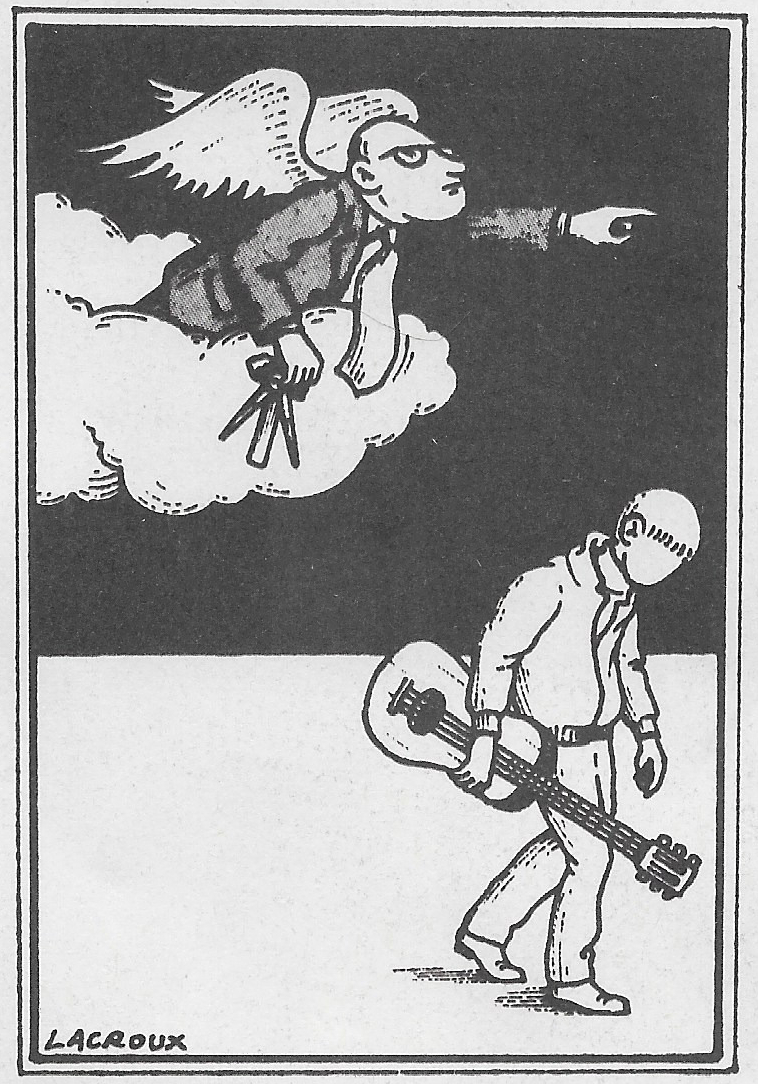

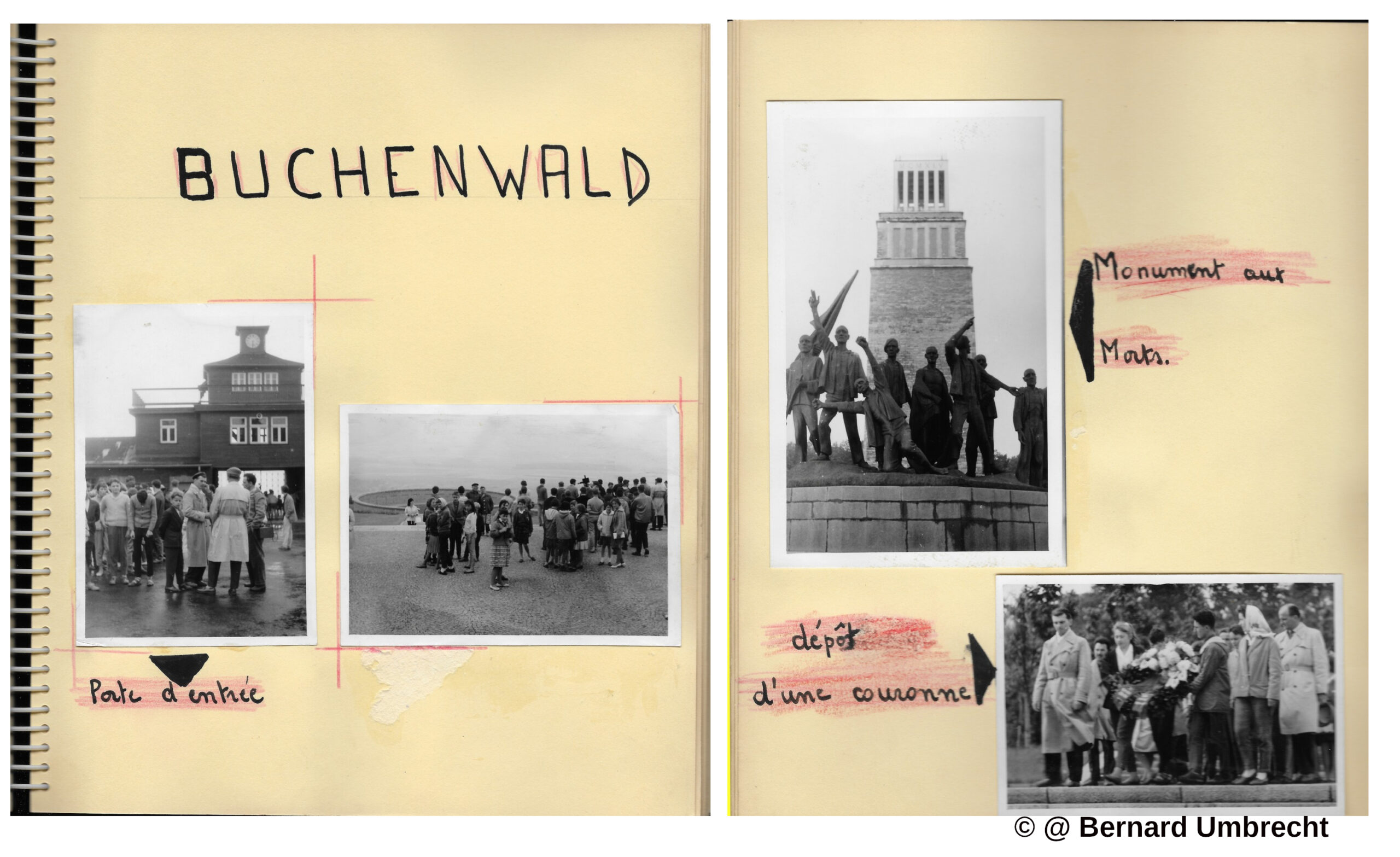

Le chanteur chassé du paradis terrestre socialiste vers ce qui passait pour l’enfer capitaliste par un seigneur porteur d’un marteau et d’un compas, emblèmes de la RDA et de l’alliance entre « travailleurs manuels et intellectuels », des catégories à interroger. Dessin de Jean-Pierre Lacroux paru dans l’hebdomadaire du PCF France Nouvelle dans un article de Gérard Belloin. Je n’ai gardé que la page et oublié d’en noter la date. Mais c’était en décembre 1976.

Acte 1 : (tout ça) pour des chansons…

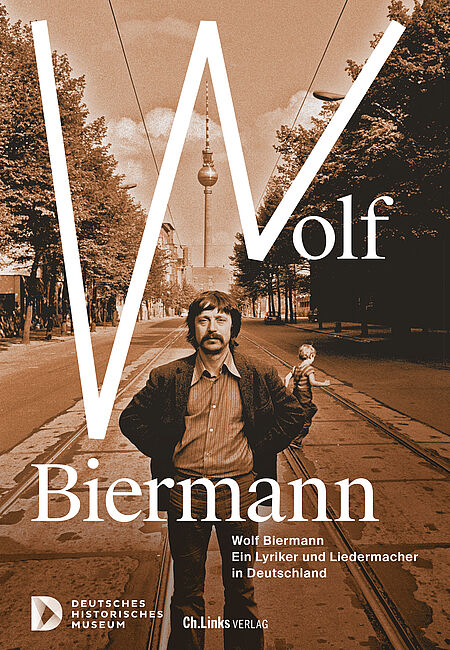

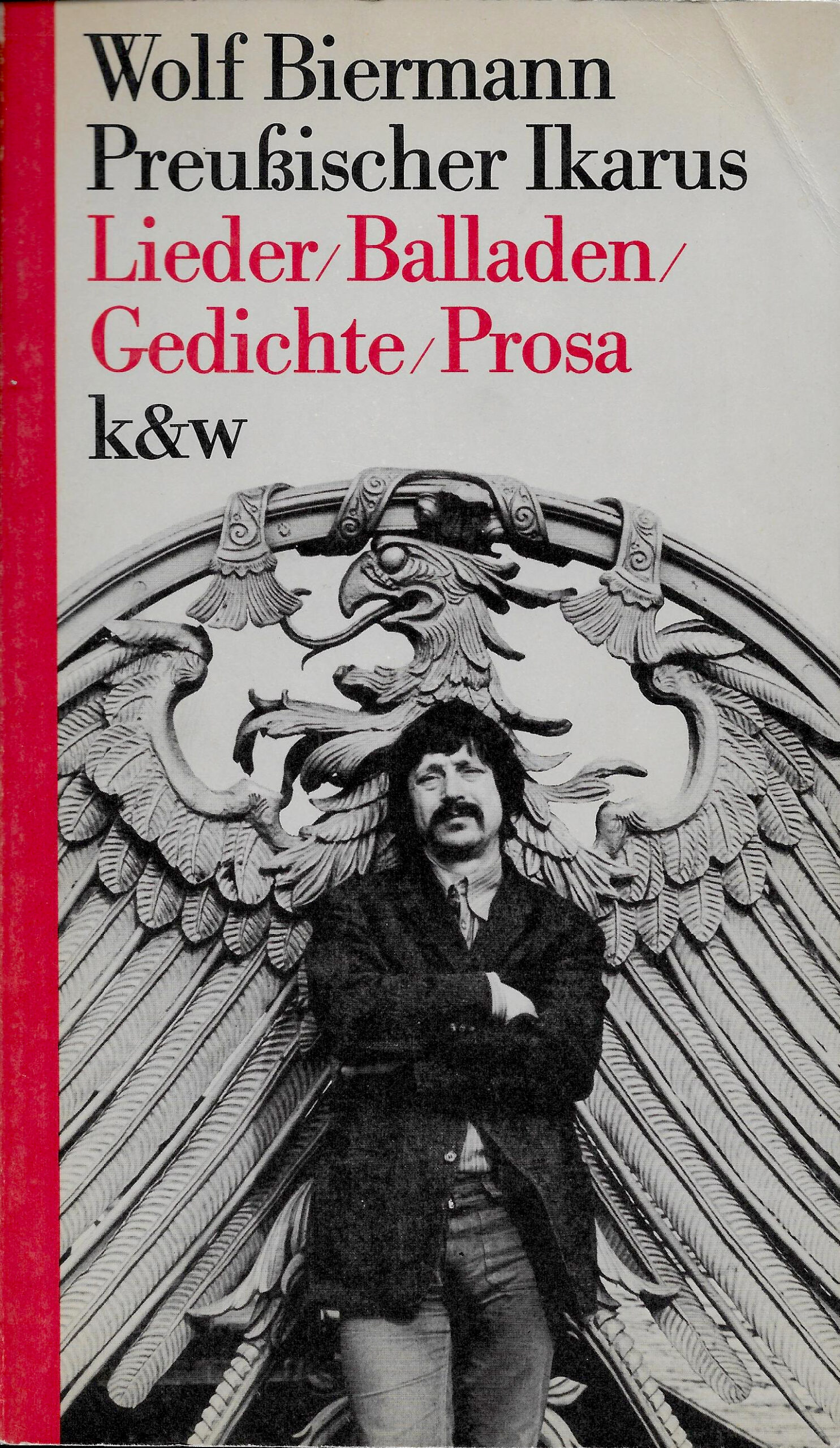

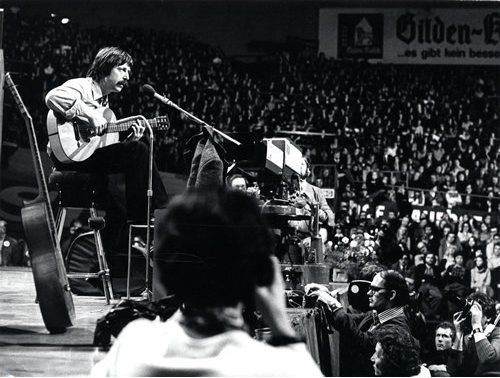

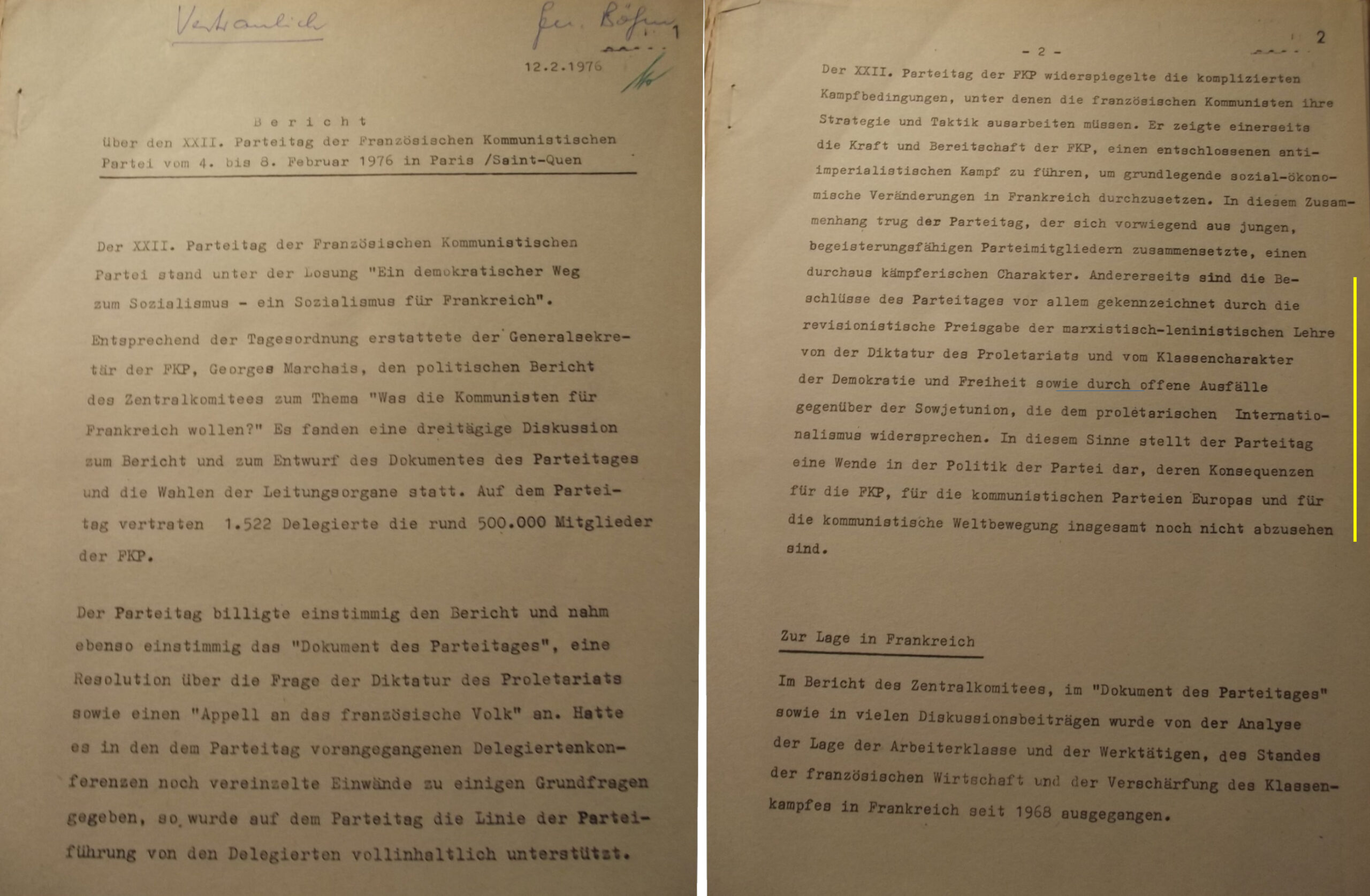

A Cologne (RFA), le concert de Wolf Biermann, autorisé à s’y rendre et persuadé qu’il pourra retourner dans son pays d’option, la RDA, eut lieu le 13 novembre 1976. Trois jours plus tard, le 16 novembre, l’agence de presse est-allemande, ADN, titra sa dépêche : le statut de citoyen de la RDA est retiré à Biermann. Déchéance de citoyenneté et non de nationalité, ce qu’en France on a du mal à comprendre. Sa nationalité allemande, il l’a gardée, devenant citoyen de l’Allemagne de l’Ouest. La dépêche, que l’on retrouvera dans tous les journaux écrits, radiophoniques ou télévisés de RDA précise que les « autorités compétentes » [??] ont retiré au chansonnier qui s’était, en 1953, venant de Hambourg, installé en RDA, « le droit de continuer d’y séjourner ». Décision prise par qui ? L’agence de presse officielle fait référence au paragraphe 13 de la loi sur la citoyenneté du 28 févier 1967. Celui-ci stipule que l’on peut retirer la citoyenneté à ceux qui manquent grossièrement [grober Verletzung] à leurs devoirs de citoyen.

„Mit seinem feindseligen Auftreten gegenüber der Deutschen Demokratischen Republik hat er sich selbst den Boden für die weitere Gewehrung der Staatsbürgerschaft entzogen“

« Par son comportement hostile envers la RDA, il s’est lui-même privé de toute possibilité de conserver sa citoyenneté ».

Classique transfert de responsabilité. Ce n’est pas nous, c’est lui qui est responsable de ce qu’il lui arrive. Variante : nous ne t’excluons pas, tu t’es exclu toi-même. Ses biens personnels lui seront remis, conclut la dépêche. L’habillage juridique cache mal qu’il s’agit d’une décision purement politique.

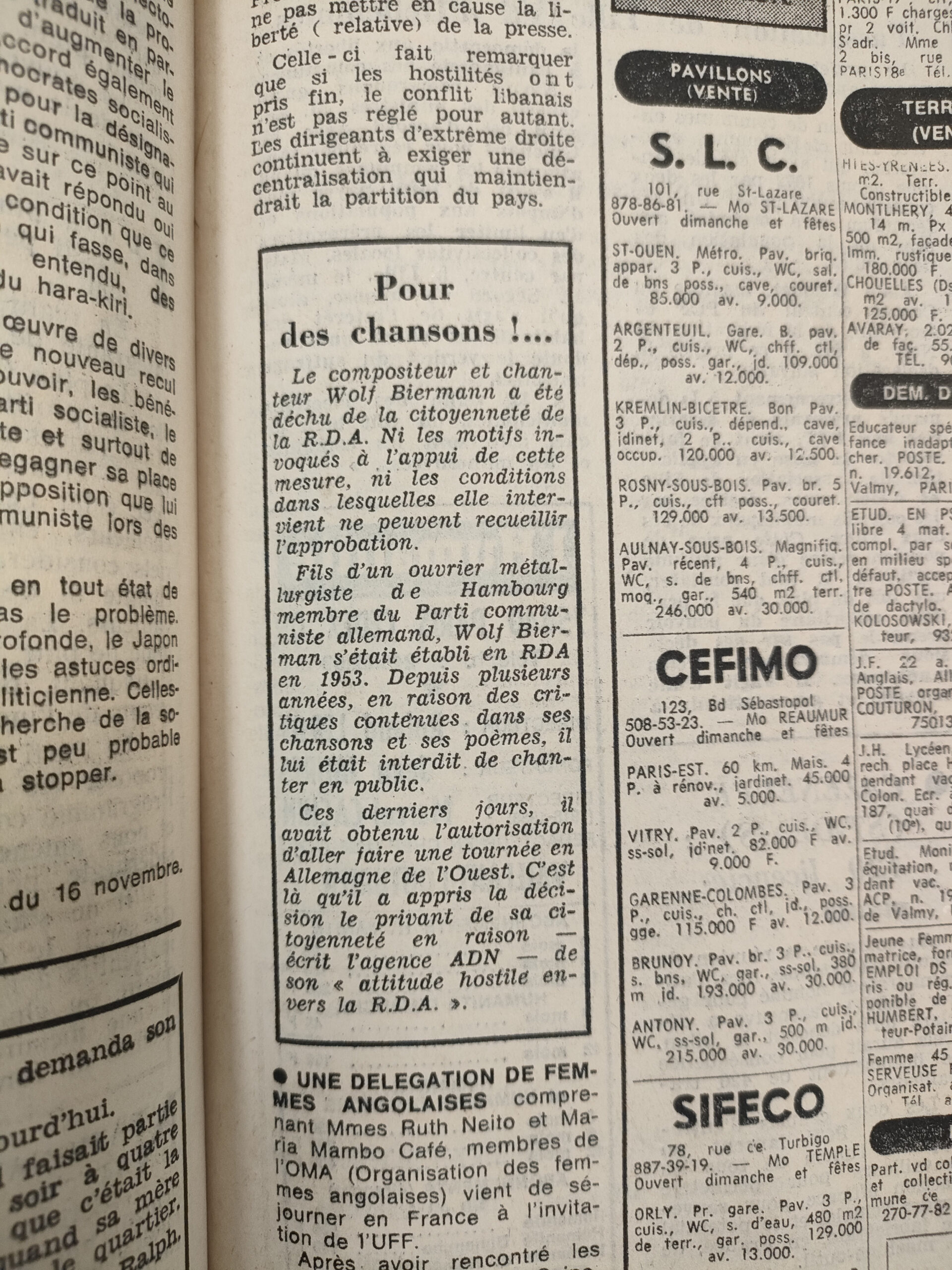

Le lendemain figure dans l’Humanité :

« Je cherchais un « grand édito », du coup passée à côté… le voici ! », t’écrit la documentaliste de L’Humanité à qui tu avais demandé de retrouver cet article, qui n’était pas de toi. Qu’elle soit remerciée. En effet, l’écho se trouve sur la page à côté de celle consacrée à la politique extérieure, avec les petites annonces. Peut-être une réaction de dernière minute. Il y est écrit que

« Je cherchais un « grand édito », du coup passée à côté… le voici ! », t’écrit la documentaliste de L’Humanité à qui tu avais demandé de retrouver cet article, qui n’était pas de toi. Qu’elle soit remerciée. En effet, l’écho se trouve sur la page à côté de celle consacrée à la politique extérieure, avec les petites annonces. Peut-être une réaction de dernière minute. Il y est écrit que

« ni les motifs invoqués à l’appui de cette décision, ni les conditions dans lesquelles elle intervient ne peuvent recueillir notre approbation »

Acte 2, césure protestataire en RDA même.

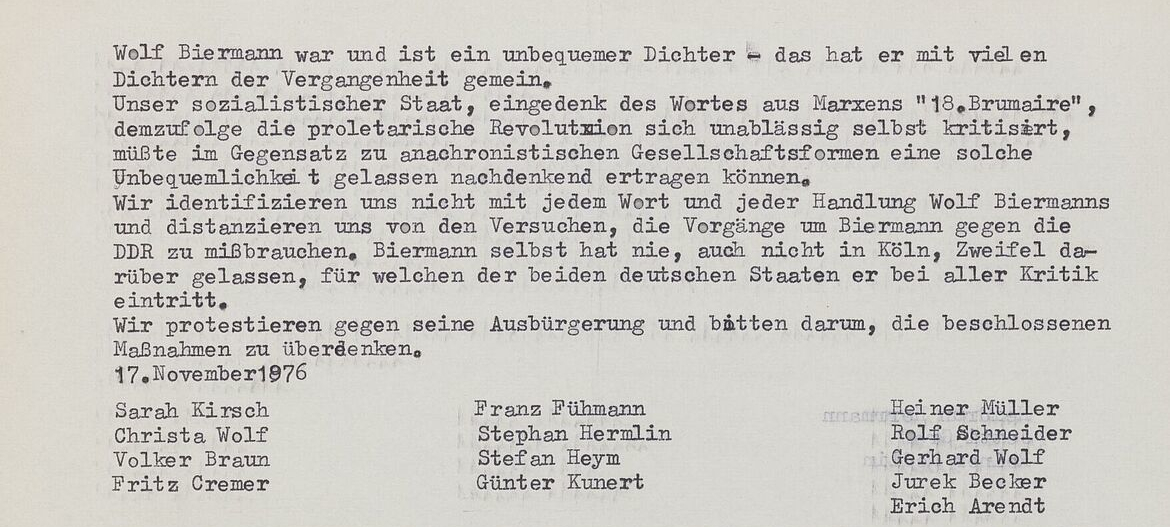

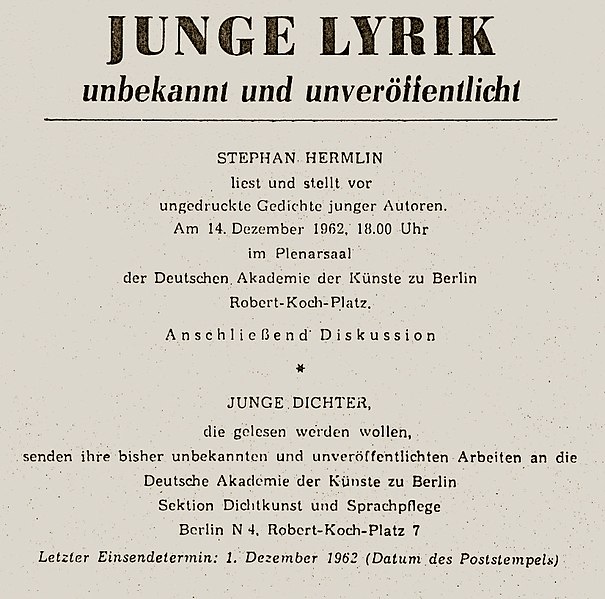

Le 17 novembre 1976, un certain nombre d’écrivain.e.s se réunissent autour de Stephan Hermlin, au domicile de ce dernier, pour rédiger une lettre ouverte à Erich Honecker, chef du parti et de l’État. Elle est transmise au destinataire et à Neues Deutschland, organe central du p. c. est-allemand, avec prière de le publier. Vœu pieu. Pour éviter les médias ouest-allemands, le texte est finalement transmis à l’AFP, avec embargo. Et à l’agence Reuter. Il a aussi été recopié et circulé dans le pays. En voici un exemplaire qui se trouve dans les archives de Wolf Biermann conservées à la Staatsbibliothek zu Berlin :

Le texte de la lettre de protestation avec les noms des premiers signataires. Extrait du document conservé dans les archives à la Staatsbibliothek de Berlin. Avec les premiers signataires. Il contient deux autres listes d’artistes qui s’y sont associés. Protestbrief gegen die Ausbürgerung Biermanns, Ost-Berlin 1976 © Staatsbibliothek zu Berlin – PK /Abteilung Handschriften und Historische Drucke /Archiv Wolf Biermann)

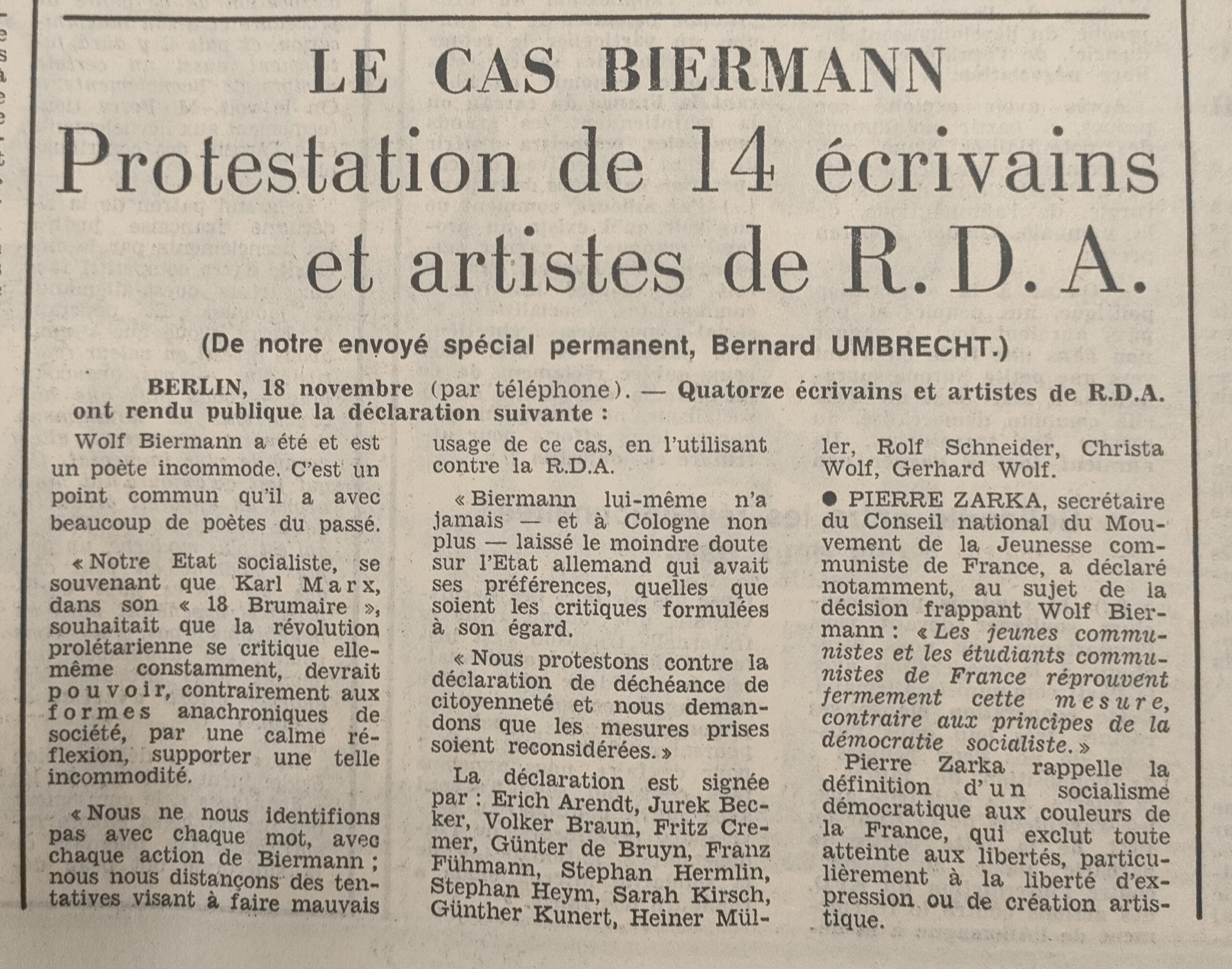

Les choses s’enclenchent alors, pour moi, le lendemain. J’entends parler de cela dans les médias ouest-allemands. Mais, j’avais besoin du document authentique et d’une source fiable. Je ne sais plus pourquoi, ni comment il se faisait que j’avais son numéro de téléphone, peut-être par un ami en RDA, j’ai pris la décision d’appeler Christa Wolf. Son grand roman Kindheitsmuster (Trame d’enfance) venait de paraître. En octobre, sauf erreur de ma part. La romancière prend la précaution de me demander si elle peut me rappeler. Au téléphone, elle me dicte le texte. Je le traduis rapidement et le transmets à L’Humanité. Le journal le publiera intégralement sans autre commentaire.

Le journal a ajouté une prise de position de Pierre Zarka, qui était alors Secrétaire général du Mouvement des jeunes communistes de France, réprouvant les mesures frappant W. Biermann. Tu reprends le texte pour le commenter.

« Wolf Biermann a été et est un poète incommode [unbequem que l’on pourrait aussi traduire par dérangeant]. C’est un point commun qu’il a avec beaucoup de poètes du passé [en fait Dichter unserer Vergangenheit (poètes de notre passé), référence au passé de la littérature allemande]. Notre État socialiste, se souvenant que Karl Marx, dans son 18 Brumaire, souhaitait que la révolution prolétarienne se critique elle-même constamment, devrait pouvoir, contrairement aux formes anachroniques de société, par une calme réflexion, supporter une telle incommodité.

Nous ne nous identifions pas avec chaque mot, avec chaque action de Biermann [petite prise de distance avec Biermann lui-même pour mieux poser la question de principe] ; nous nous distançons des tentatives visant à faire mauvais usage de ce cas en l’utilisant contre la RDA.

Biermann lui-même n’a jamais – et à Cologne non plus – laissé le moindre doute sur l’État allemand qui avait ses préférences qu’elles que soient les critiques formulées à son égard.

Nous protestons contre la déclaration de déchéance de citoyenneté [la mesure de déchéance de citoyenneté prononcée à son égard [= seine Ausbürgerung] et demandons [bitten. A la demande du sculpteur Fritz Cremer, le mot fordern avait été remplacé par bitten] à ce que les mesures prises soient reconsidérées [überdenken] »

Concis, bien senti, fort si l’on se reporte au contexte de l’époque, quoique relativement retenu. N’y figure pas, par exemple, le ressenti qu’une telle mesure de déchéance de citoyenneté n’avait plus été prise en Allemagne depuis la période nazie. « Peu de phrases comme celles-ci n’ont jamais à ce point secoué la RDA » (Hans Dieter Schütt : Hermlin, Entlang einser Dichters. Quintus Verlag. 2023. p. 158). Tu ajoutes une précision concernant la référence à Karl Marx. Dans son 18 Brumaire, il avait écrit que « les révolutions prolétariennes », au contraire de celles de la bourgeoisie,

« se critiquent elles-mêmes constamment, interrompent à chaque instant leur propre cours, reviennent sur ce qui semble déjà être accompli pour le recommencer à nouveau, raillent impitoyablement les hésitations, les faiblesses et les misères de leurs premières tentatives, paraissent n’abattre leur adversaire que pour lui permettre de puiser de nouvelles forces de la terre et se dresser à nouveau plus formidable encore en face d’elles, reculent constamment à nouveau devant l’immensité infinie de leurs propres buts, jusqu’à ce que soit créée enfin la situation qui rende impossible tout retour en arrière, et que les circonstances elles-mêmes crient : Hic Rhodus, hic, salta ! [Voici Rhodes, c’est ici qu’il faut sauter. » (Proverbe latin inspiré d’une fable d’Ésope qui signifie : c’est le moment de montrer ce dont tu es capable)].

(Karl Marx : Le 18 brumaire du Louis Napoléon Bonaparte (1849) Éditions sociales. 1969. En ligne)

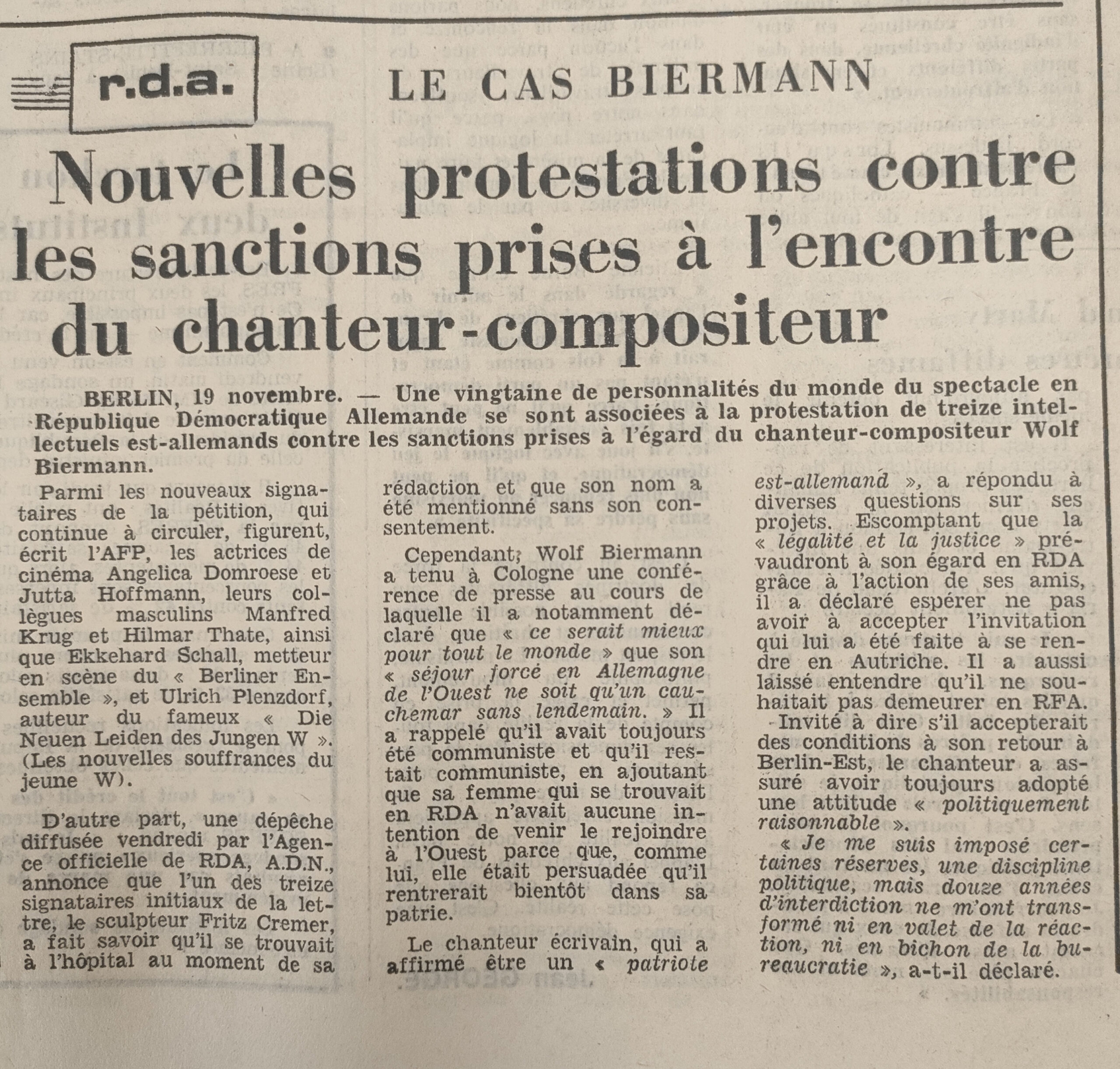

Il y a là une technique fréquemment utilisée pour critiquer le SED. Elle consiste à le renvoyer à la lecture de Marx, ou, comme je l’ai déjà évoqué, à Rosa Luxemburg. Si, bien entendu, le texte demande au pouvoir en place de reconsidérer, probablement sans illusion, la décision de déchéance – inédite depuis le nazisme – la question posée de son « anachronisme » dépasse largement le cas Biermann. Elle porte sur celle de permettre la création d’un espace public de discussion. « Il y a deux partis en RDA, disait Heiner Müller, le SED et les écrivains ». Situation particulièrement inconfortable pour ceux-ci dont ce n’est pas la fonction et dont ils voulaient sortir. La protestation s’inscrit dans une histoire qui, en particulier pour la jeune génération née en RDA, commence, en 1968, avec des contestations de l’intervention des troupes du Pacte de Varsovie en Tchécoslovaquie pour mettre un terme au Printemps de Prague. A la différence, toutefois, que celle de 1976 est d’emblée bien plus publique. D’autant que rapidement et de manière plutôt inattendue, la liste des signataires s’allonge. L’Humanité en fait état sur la base des dépêches d’agences.

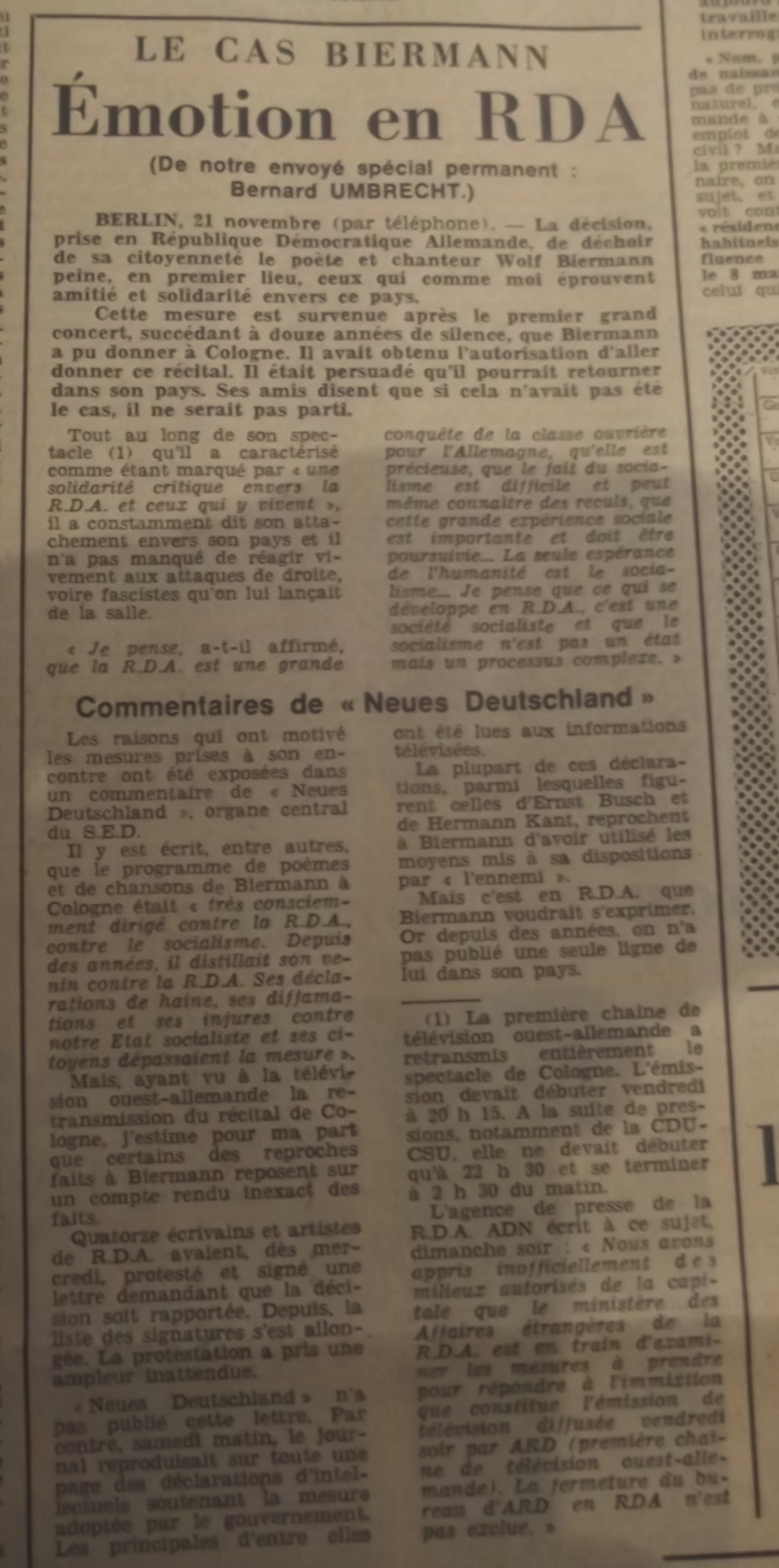

Émotion en RDA

L’article ci-dessus n’est pas de moi. Le suivant l’est. Il est titré : Émotion en RDA

Un article dans lequel tu te fais curieusement un peu éditorialisant, écrivant que la décision de déchéance de citoyenneté prise à l’encontre de Wolf Biermann « peine en premier lieu ceux qui comme moi éprouvent amitié et solidarité » envers la RDA. Dans le tapuscrit, que tu as conservé de l’article, ce « comme moi » ne figure pas. J’affirme que tout au long de son concert, il a affiché « une solidarité critique » envers son pays et ceux qui y vivent. Dans le chapitre consacré au commentaire de Neues Deutschland sur l’« affaire », tu avances qu’ « ayant vu le concert de Cologne à la télévision, j’estime, pour ma part » (là tu dis je), que certains des reproches avancés par l’organe central du SED à l’encontre du chansonnier « reposent sur un compte-rendu inexact des faits ». Culotté quand même, ça ment de ce côté-ci du Mur.

Sur la même page, en bas du mien, se trouve un article intitulé : « A propos de la situation littéraire en RDA ». Il est signé de Claude Prévost. D’abord un petit mot sur cet agrégé et enseignant d’allemand à la khâgne de Poitiers qui était aussi chroniqueur littéraire régulier au quotidien. Je cite un extrait de l’hommage que lui rendit André Gisselbrecht, autre germaniste communiste :

« Passé à la littérature dite « générale », à l’esthétique (d’abord marxiste, si cela existe), il n’a jamais abdiqué son identité de germaniste. Elle lui permettait entre autres de lire beaucoup de livres théoriques en traduction allemande. À L’Humanité, on lui a un temps reproché de privilégier dans sa page du mercredi les ouvrages traduits de l’allemand. C’était essentiellement des romans, l’art narratif étant demeuré sa prédilection. Il avait dans le domaine germanique ses étoiles fixes : d’abord Hölderlin, puis Peter Härtling ; enfin Christa Wolf […]

Bien sûr, germaniste communiste, sans négliger en rien la grande littérature de la RFA, sa passion, aux deux sens du terme, s’appelait « RDA ». Il y guettait les moindres signes d’ouverture. Après 1971, la période dite officiellement du « socialisme développé », achevée brutalement en 1976, lui fit croire que les écrivains de là-bas seraient plus que des délégués du pouvoir pour suppléer à l’absence d’opinion publique, et que la liberté d’expression leur serait accordée. Lorsque Wolf Biermann fut déchu de sa citoyenneté, il protesta dans l’organe officiel du « parti frère » [L’Humanité], ce qui lui valut d’être déclaré persona non grata en RDA ; il ne la revit que deux ans avant sa disparition, qui l’affecta durement »

(André Gisselbrecht : Claude Prévost in memoriam. In Allemagne d’aujourd’hui, N°120, avril-juin 1992.

Claude Prévost opère un glissement de l’« affaire » Biermann vers une réflexion plus générale sur la situation littéraire en RDA. Il a d’abord noté que le cas Biermann n’est pas isolé, avec l’exemple de Reiner Kunze qui a été exclu de l’Union des écrivains pour avoir édité à l’Ouest son recueil de prose, traduit en français sous le titre Les années merveilleuses (Seuil 1978). Le chroniqueur conclut que nous assistons « à des tendances de retour en arrière – dont la persistance ne pourrait que nuire au socialisme en Allemagne et dans le monde »

Claude, je l’ai peu rencontré. Nous échangions par articles interposés et par lettres. Par son intermédiaire, j’ai pu rencontrer quelques « intellectuel.les » est-allemand.e.s dont certain.e.s sont devenu.e.s des ami.e.s.

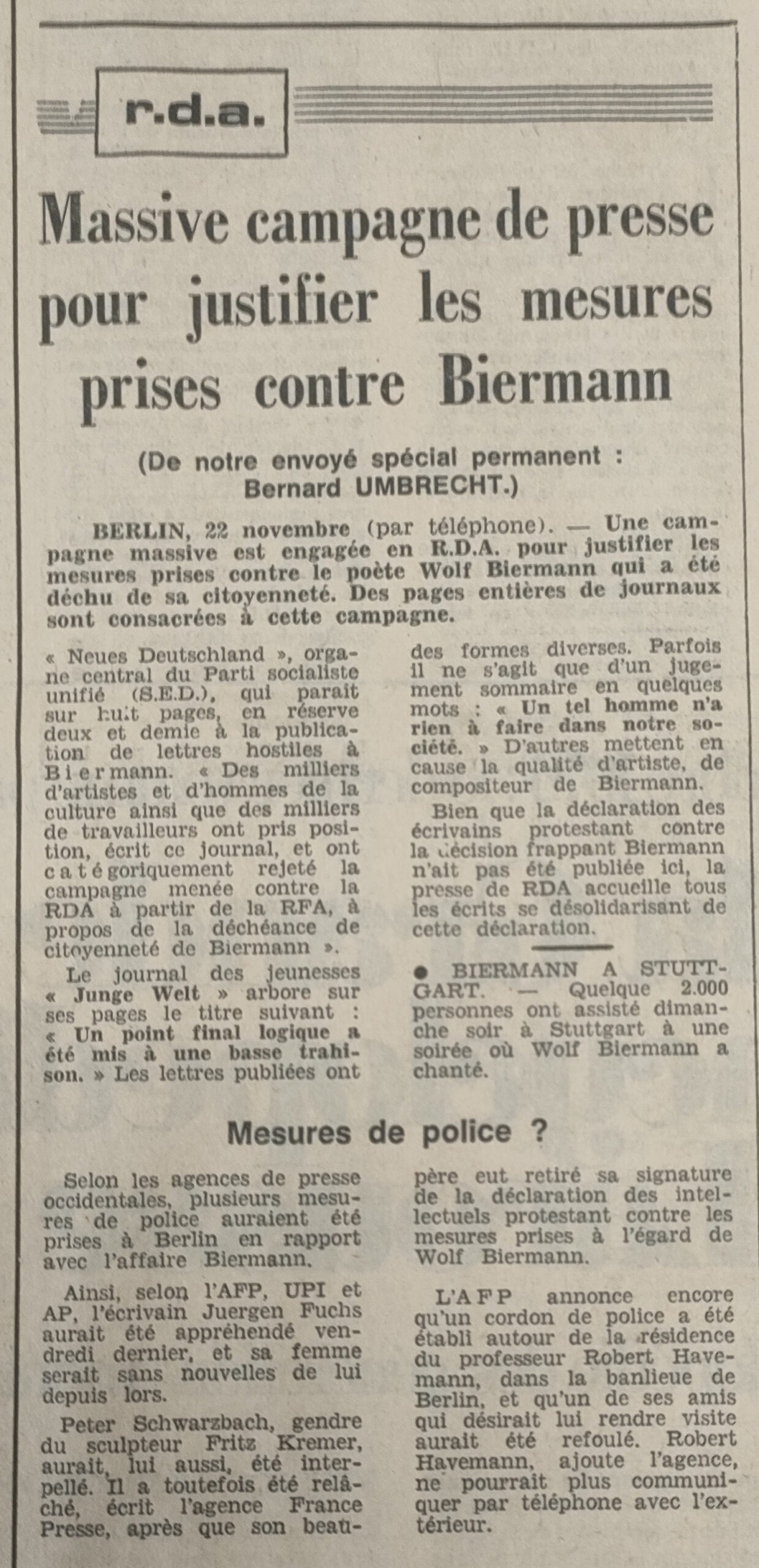

Massive campagne

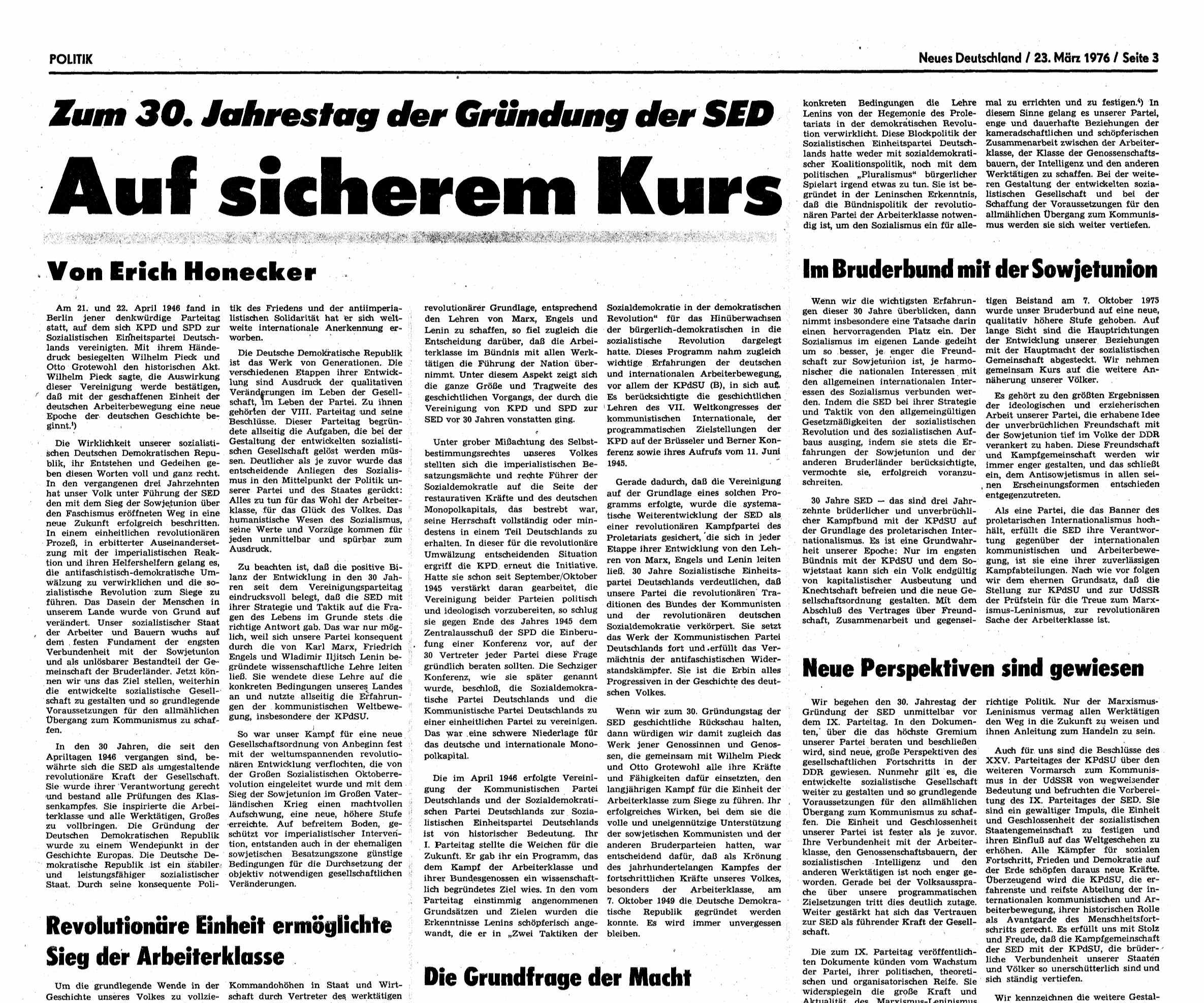

Les autorités est-allemandes réagissent par une massive campagne de presse mobilisant tous les médias du pays, écrits, parlés, télévisuels. Ainsi cette double page de Neues Deutschland ( Édition des 20 et 21 novembre 1976) :

J’en parle dans le journal du 23/11

Le texte est réduit au minimum. Je donnais quelques détails, sans grand intérêt toutefois. Sur des pages entières, en plusieurs éditions, et dans tous les journaux de RDA, qu’ils soient régionaux ou supra régionaux, les dirigeants est-allemands font croire qu’ils bénéficient d’un vaste soutien dans la population, à commencer par les milieux de la culture. A vouloir entrer à nouveau dans les détails de ce mélange de contorsions rhétoriques, d’hypocrisies et d’opportunisme, ne serait-ce que parce qu’aucune prise de position ne voulait ou ne pouvait avouer avoir vu le concert de Biermann, tes doigts se rebiffent à la saisie. Reprenant les informations des agences de presse, le quotidien du PCF évoque l’arrestation de Jürgen Fuchs, signataire de la pétition, et l’assignation à résidence du physicien et chimiste Robert Havemann. Jürgen Fuchs ainsi que Gerulf Panach et Christian Kunert qui formaient un groupe musical interdit, en 1975, avaient été emprisonnés et après plusieurs mois de détention, sous la menace de peines plus lourdes, contraints de s’exiler à Berlin-Ouest. De Fuchs sont parus en France ses terribles Souvenirs d’interrogatoire.

Le texte est réduit au minimum. Je donnais quelques détails, sans grand intérêt toutefois. Sur des pages entières, en plusieurs éditions, et dans tous les journaux de RDA, qu’ils soient régionaux ou supra régionaux, les dirigeants est-allemands font croire qu’ils bénéficient d’un vaste soutien dans la population, à commencer par les milieux de la culture. A vouloir entrer à nouveau dans les détails de ce mélange de contorsions rhétoriques, d’hypocrisies et d’opportunisme, ne serait-ce que parce qu’aucune prise de position ne voulait ou ne pouvait avouer avoir vu le concert de Biermann, tes doigts se rebiffent à la saisie. Reprenant les informations des agences de presse, le quotidien du PCF évoque l’arrestation de Jürgen Fuchs, signataire de la pétition, et l’assignation à résidence du physicien et chimiste Robert Havemann. Jürgen Fuchs ainsi que Gerulf Panach et Christian Kunert qui formaient un groupe musical interdit, en 1975, avaient été emprisonnés et après plusieurs mois de détention, sous la menace de peines plus lourdes, contraints de s’exiler à Berlin-Ouest. De Fuchs sont parus en France ses terribles Souvenirs d’interrogatoire.

Vu d’aujourd’hui cela a l’air bien anodin. Néanmoins, tout indique que nous marquions des points sur le terrain de la défense des libertés et de la démocratie en n’oubliant pas la réalité des pays de l’Est. C’est ce que relève le responsable de la rubrique culture de l’hebdomadaire du PCF, France nouvelle. Gerard Belloin écrit en effet, à propos du cas Biermann :

« D’habitude si prompts à monter en épingle ce genre d’affaire et à« en rajouter », ils [les grands moyens d’information] font preuve, cette fois, d’une discrétion que l’on peut, à bon droit, questionner. Tout se passe comme si « l’affaire » ne les intéressait plus à partir du moment où ils ne peuvent pas l’exploiter à des fins de politique intérieure. En clair : contre le PCF et, au – delà, contre l’union de la gauche. « Le Quotidien de Paris » de mardi dernier pouvait titrer, à propos de cette attitude : « Quand « l’Huma » dévoile à ses lecteurs ce que cache la presse de droite ».

Quelques réactions en France

Tu n’as pas de vue d’ensemble des réactions en France, excepté quelques prises de position individuelles ou collectives. L’écrivain Raymond Jean, membre du PCF et de France-R.D.A a publié une tribune dans le journal Le Monde du 10 décembre, dans lequel il évoque toute une série de chanteurs, compositeurs, musiciens de différents pays dans le monde subissant la répression :

« Au Chili, Wolf Biermann aurait sûrement eu les mains coupées et aurait été assassiné comme Victor Jara. En Allemagne fédérale, comme communiste, il ne peut pas travailler dans la fonction publique (et. d’ailleurs, n’y pense pas). En RDA, comme » communiste critique « , il est déchu de sa nationalité et mis à la porte. Une fatalité particulière s’abattrait-elle sur les chanteurs, les compositeurs et les musiciens ? Récemment à Moscou, Piotr Startchik a été interné dans un hôpital psychiatrique – pour la deuxième fois, d’ailleurs, – parce qu’il avait tiré un certain nombre de chansons de poèmes d’Ossip Mandelstam et de Marina Isvetaeva et qu’il les avait interprétées devant des amis.

À Prague, on le sait, ce sont quatre paroliers, chanteurs et musiciens, Ivan Jirous Pavel Zajicek, Svatopluk Karasek et Vratislav Brabenec, artistes ou étudiants, qui viennent d’être condamnés à de lourdes peines de prison pour avoir sacrifié à la musique pop et animé certains groupes comme Plastic People. Tout se passe comme si le chant était particulièrement insupportable à certains systèmes, peut-être parce qu’il est porteur de trop de liberté ou de trop de joie, peut-être simplement parce qu’il fait trop de bruit. Il est triste de constater que ce sont parfois des systèmes politiques, dont la vocation est de préparer des lendemains qui chantent. »

La présidence de l’association France-RDA, qui militait pour la coopération et le développement des échanges entre la France et la RDA, après l’avoir fait pour la reconnaissance par la France de l’autre Allemagne, se faisait, le 24 novembre 1976, « l’interprète de l’émotion exprimée par de nombreux adhérents pour déplorer la décision de déchéance de la citoyenneté de la RDA qui frappe le poète-chansonnier Wolf Biermann. Elle souhaite que soit levée une mesure qui risque de ternir l’image de la RDA dans notre pays ».. (Gilbert Badia : L’association France-RDA [en ligne]. in : La RDA et l’Occident (1949-1990) Paris : Presses Sorbonne Nouvelle, 2000

Autour de membres de la revue Allemagne d’aujourd’hui, s’était créé, début décembre un Comité Wolf Biermann, pour le libre retour [du chanteur] dans son pays, et contre la répression en RDA. Il était présidé par Vercors.

L’écrivain, poète et traducteur Alain Lance t’a signalé l’existence d’une pétition d’écrivains français passée totalement inaperçue. Il t’a raconté :

« Lorsque, à l’automne 1976, après son concert à Cologne, Wolf Biermann a été déchu de sa citoyenneté est-allemande par les autorités de la RDA, j’étais au comité de fonctionnement de l’Union des écrivains en France. J’ai proposé à notre président le poète Eugène Guillevic de rédiger avec Vladimir Pozner une pétition d’écrivains français pour protester contre cette mesure. De nombreux écrivains l’ont signée, dont Aragon.

Un membre du bureau politique du PCF, m’a téléphoné un soir (ce n’est pas un hasard s’il contactait le jeunot que j’étais et non Guillevic ou Pozner !) pour critiquer cette initiative : selon lui, il eût été préférable et plus efficace de s’adresser au bureau politique du PCF, qui eût alors transmis aux dirigeants du SED en RDA. Et puis il trouva que, pour une pétition d’écrivains, celle-ci n’était pas très bien écrite… Je lui ai fait remarquer que cela n’avait pas empêché Aragon de la signer. Ce qui lui inspira cette réplique : « Ah que veux-tu… Louis… »

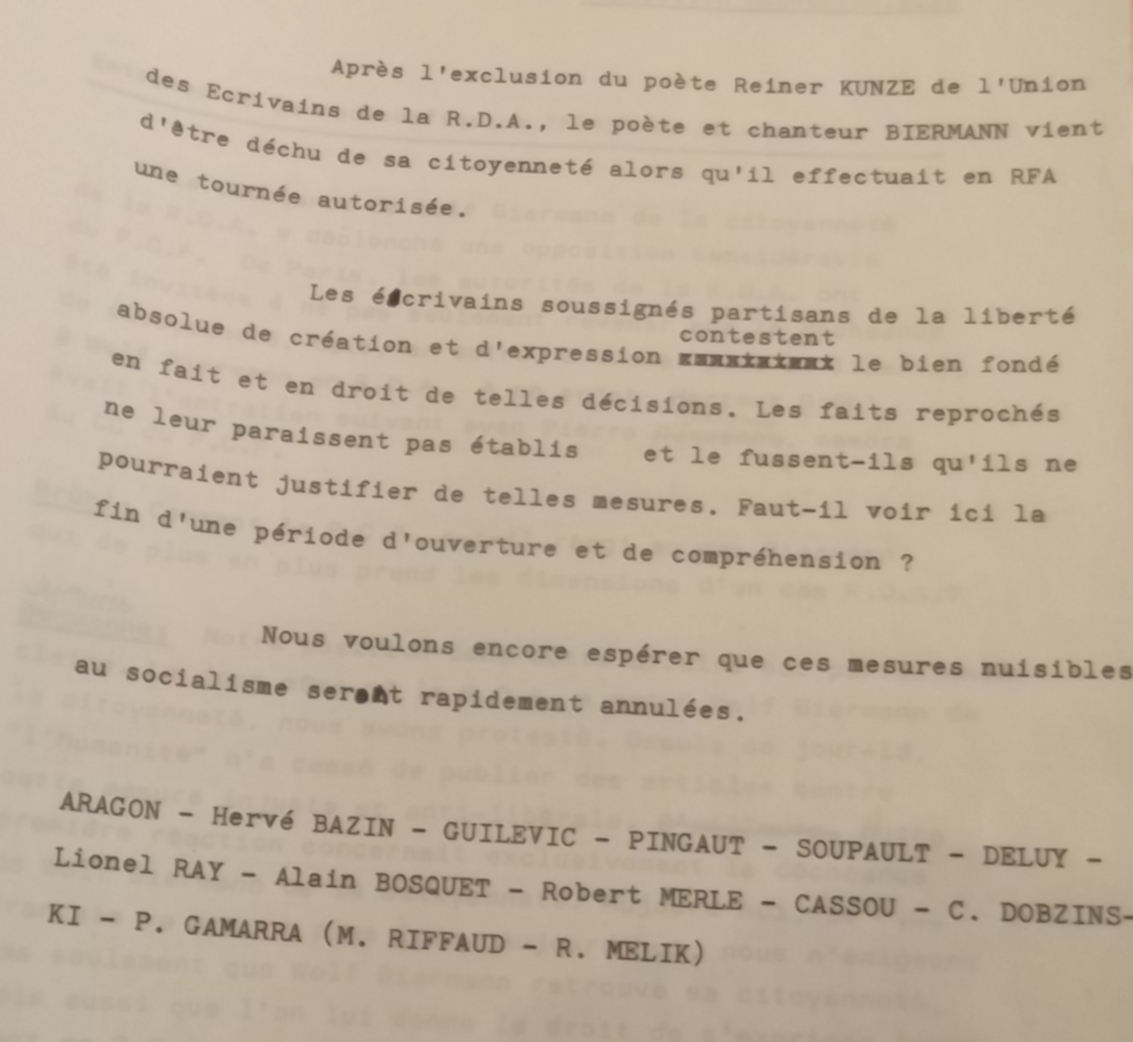

Le Monde a signalé la pétition, mais pas L’Humanité. Elle a laissé peu de traces. Alain Lance n’avait plus le texte. Tu l’as retrouvé, à Bobigny, dans les archives de Jean Kanapa qui l’avait conservé. Ce n’est peut-être qu’un brouillon. La liste des signataires en tous les cas ne semble pas complète. Le journal Le Monde parlait d’une soixantaine d’autrices et d’auteurs. Que disait cette pétition ? En voici le texte :

« Après l’exclusion du poète Reiner Kunze de l’Union des écrivains de la RDA, le poète et chanteur Biermann vient d’être déchu de sa citoyenneté alors qu’il effectuait en RFA une tournée organisée.

Les écrivains soussignés partisans de la liberté absolue de création et d’expression contestent le bien fondé en fait et en droit de telles décisions, les faits reprochés ne leur paraissent pas établis et le fussent-ils qu’ils ne pourraient justifier de telles mesures. Faut-il voir ici la fin d’une période d’ouverture et de compréhension ? Nous voulons encore espérer que ces mesures nuisibles au socialisme seront rapidement annulées »

C’est signé ARAGON, Hervé BAZIN, GUILLEVIC, PINGAUT, SOUPAULT, DELUY ; Lionel RAY, Alain BOSQUET, Robert MERLE, CASSOU, C. DOBZINSKI, Pierre GAMARRA (M. RIFFAUD – R. MELIK)

Juquin serre la main de Plioutch

Tout cela donne l’impression, sans doute justifiée, que le PCF y allait un peu sur la pointe des pieds. Certes, ce qui figurait dans l’Humanité passait pour être « la ligne » du parti communiste mais tu ne connais aucune déclaration, en France, des instances dirigeantes du PCF ou d’un de leurs représentants, à l’exception citée du Mouvement des jeunesses communistes. Tu as toutefois découvert, toujours dans les archives de Jean Kanapa, le script d’un entretien de Pierre Juquin, autre germaniste, membre du comité central, à la radio de Berlin-Ouest, RIAS (Radio in the American Sector). Il y aurait affirmé :

« Notre première réaction concernait exclusivement la déchéance de Wolf Biermann de sa citoyenneté. Aujourd’hui le PC français va encore plus loin. Aujourd’hui, nous n’exigeons pas seulement que Biermann retrouve sa citoyenneté, mais aussi que l’on lui donne le droit de s’exprimer librement en RDA, de composer et que l’on publie ses travaux et ses chansons ».

Tu n’as trouvé aucune trace de ces propos en France, pas même dans les mémoires de leur auteur. (Pierre Juquin : De battre mon cœur n’a jamais cessé. L’archipel. 2006). Il est vrai que même pas un mois avant l’« affaire » Biermann, le même Juquin avait serré la main du « dissident » soviétique Léonid Plioutch. Le PCF avait été invité par le mathématicien Laurent Schwarz à un meeting à la Mutualité en solidarité aux prisonniers d’opinion aussi bien d’Amérique latine que d’Union soviétique. La direction du parti, après avoir tergiversé, donne son aval pour y participer. Le mathématicien Léonid Plioutch, interné en hôpital psychiatrique du KGB et qui avait été expulsé en France au début de l’année, était présent. Juquin et Plioutch se sont serré la main sous les flashes des photographes. Au grand dam des Soviétiques, Juquin demande, au nom du PCF, la liberté tant pour Vladimir Boukovski, Semyon Gluzman, tous deux d’Urss, Jiri Muller de Tchécoslovaquie, ainsi que pour le mathématicien uruguayen José Luis Massera, Victor Lopez Arias de Bolivie, Edgardo Enriquez Espinos du Chili.

Revenons à la RDA. Les autorités du pays ne s’attendaient pas à une telle avalanche de réactions. Elles pensaient que cela allait se tasser vite. Qui plus est, les réactions des partis communistes espagnol, italien, français ainsi que celles d’autres « amis » de l’Allemagne de l’Est rendaient l’argument selon lequel Biermann s’était vendu à l’ennemi difficilement tenable. Mais cela n’a pas empêché le SED de persévérer et de profiter de la situation pour se débarrasser de quelques-uns de ces chanteurs ou écrivains dérangeants. Plus d’une centaine d’écrivain.e.s et d’artistes quitteront à plus ou moins brève échéance, en l’espace d’une année, soit volontairement soit sous la contrainte, leur pays : Kurt Bartsch, Bernd Jentzsch, Thomas Brasch, Sarah Kirsch, Hans Joachim Schädlich, Reiner Kunze, Jurek Becker, Günter Kunert, Erich Loest. Klaus Schlesinger…, pour les écrivains, mais aussi Katharina Thalbach, Manfred Krug, Eva-Maria Hagen, Nina Hagen, Armin Mueller-Stahl, Angelica Domröse, Hilmar Thate… Sans compter les exclusions de l’Union des écrivains.

A côté de cette hémorragie, l’autre conséquence porte sur le contenu même de la littérature. On ne prend plus la RDA comme sujet direct de roman ou de théâtre au profit de thèmes historiques ou issus de la mythologie. Les lecteurs et spectateurs n’ont cependant pas été dupes car, derrière, la réalité est-allemande restait bien présente. Ce sera une forme de « littérature palimpseste » c’est à dire de textes contenant d’autres textes. Je tiens cette notion d’une conversation avec Stephan Hermlin. Elle m’avait marquée.

Je parle tout de même aussi de l’augmentation des pensions d’invalidité et des retraites pour 3,4 millions de personne soit près de 20 % de la population, sans rapport avec une inflation inexistante. J’évoque aussi l’examen de besoins nouveaux de la population par le Comité central du SED. Il y est fait état de « nombreuses critiques » émanant de la population notamment sur les problèmes de logement. Citation officielle : « Les travailleurs signalent que souvent et à peu de frais des logements peuvent être obtenus et les conditions de logement améliorées si les réparations sont effectuées à temps. Les critiques sur le travail des administrations communales responsables des logements concernent avant tout le comportement bureaucratique des fonctionnaires, l’insuffisance de coopération avec les associations d’habitants ». Enfin, j’aborde la question du rôle du progrès des sciences et des techniques pour améliorer la production. Je me suis efforcé de fouiller dans les textes officiels, d’une lecture fastidieuse, en quête du moindre indice s’écartant d’une vision idyllique prétendant que tout allait pour le mieux dans le meilleur des mondes.

Le 19 décembre 1976, un autre évènement allait occuper des colonnes du journal : l’échange sous l’égide des services états-uniens, à Zurich, entre deux prisonniers politiques Luis Corvalan, dirigeant du Parti communiste chilien, prisonnier du régime de Pinochet et Vladimir Bukovsky, célèbre dissident soviétique emprisonné par le pouvoir de Brejnev. Ce chassé-croisé, Georges Marchais l’avait jugé « lamentable ». J’en parle ici car Luis Corvalan viendra en RDA au début de l’année suivante. Ces prises de positions ont eu pour conséquence le report de la visite prévue fin décembre d’une délégation du PCF à Moscou puis à Berlin-Est.

J’anticipe un peu sur l’année suivante pour rester dans le fil des suites de l’« affaire » Biermann. J’écrirai, le 12 décembre 1977 : « Encore un écrivain qui émigre / Hans Joachim Schädlich ». Le papier contient une liste d’écrivains qui ont quitté l’Allemagne de l’Est, en l’espace d’un an. Il est suivi d’une analyse de Claude Prévost : « RDA et Culture : Motifs d’inquiétude ». Il y constate que la situation et les problèmes se sont aggravés. D’autant que venait s’ajouter un autre cas, celui de Rudolf Bahro, docteur en philosophie et professeur d’écologie sociale, auteur de L’alternative, une critique d’ampleur du socialisme réellement existant. Nos deux articles feront sortir de ses gonds un membre du bureau politique du SED. Cela, tu ne l’apprendras que bien plus tard et tu le raconteras dans le prochain épisode.

Si cela m’a valu de la sympathie parmi les intellectuels du parti communiste, j’ai pu constater, lors de rencontres avec d’anciens camarades, lors de mes passages à Mulhouse, que mes articles soulevaient pour le moins quelque perplexité. On ne comprenait pas le pourquoi de ces critiques Je me rendrai compte que cela ne passait pas dans le parti. Par manque d’un minimum de constance depuis l’écrasement du Printemps de Prague, faute de se doter d’outils d’intelligence du réel à l’égard des pays socialistes. Aussi en raison de ses liens avec les enjeux de l’Union de la gauche et de la division de l’Allemagne. Le PCF retombera dans l’anachronisme que dénonçaient judicieusement les signataires de la protestation qui était devenue une pétition.

À suivre…

Parution de Florilangues.

Une ouverture vers les littératures en langues de France

« Avec science et avec cœur, Florilangues nous rappelle opportunément que, face à la dictature du semblable, le plurilinguisme est un recours. La France détient dans la floraison de ses idiomes l’une de ses richesses ; elle trouve dans leur protection et leur enseignement son honneur et, quand tout se globalise, une politique salutaire. »

Barbara Cassin

Bernard Cerquiglini

Je propose d’inscrire la citation, extraite de la préface, dans un contexte plus large, celui dans lequel les technologies numériques standardisent, homogénéisent, synchronisent (des-historisent) les relations sociales tout comme les langues et les idiomes. Je l’avais ‘avais déjà évoqué ici, à savoir que, comme l’écrivent Anne Alombert, Vincent Puig et Bernard Stiegler, dans l’ouvrage Bifurquer :

« Les algorithmes de Google tendent ainsi à soumettre les langages dits naturels aux contraintes de l’économie mondiale, éliminant les formes idiomatiques les moins calculables qui sont au principe de l’évolution diachronique des langues, donc de leur diversité et de leur historicité, – et court-circuitant les localités où se produisent les idiomes. » (Bifurquer. Éditions Les liens qui Libèrent. Chapitre Design contributif. p 251)

C’est écrit avant l’émergence de la pseudo « IA » générative. Mais venons-en à notre sujet proprement dit.

Cette anthologie, forcément sélective, constitue une ouverture vers les langues de France à travers leurs littératures. C’est un projet militant, des contributeurs à l’éditeur, mis en œuvre par le collectif Pour les littératures en langues régionales à l’école. Ce dernier s’est fixé un objectif simple : que l’école de la République accorde une place véritable à ces littératures, de Métropole et des Outre-mer, dans le cadre des cours de français. Dans un premier temps, une pétition a obtenu le soutien de nombreuses personnalités. Elle a recueilli à ce jour plus de 18 000 signatures avant de recevoir l’appui de Amin Maalouf, secrétaire perpétuel de l’Académie française. Pour finalement déboucher sur la réalisation de cet ouvrage à vocation pédagogique. Il rassemble 35 textes initialement créés dans 16 langues différentes : alsacien, basque, breton, catalan, corse, créole guadeloupéen, créole guyanais, créole martiniquais, créole réunionnais, flamand occidental, nengone (langue de l’archipel kanak), normand, occitan-langue d’oc, palikur (langue amérindienne de Guyane), picard et tahitien. Chaque texte est accompagné de sa traduction française, et contextualisé par la présentation des différentes littératures et de leurs autrices et auteurs. Le tout est précédé d’une introduction générale qui brosse un tableau global de la situation sociolinguistique de nos langues et des productions littéraires (roman, nouvelle, poésie, théâtre) dans leurs différents domaines. Elles s’échelonnent du Moyen Âge au siècle actuel. Le livre est préfacé par Barbara Cassin, philologue, helléniste, philosophe, docteure ès lettres en philosophie, médaille d’or du CNRS, membre de l’Académie française et par Bernard Cerquiglini, Professeur émérite de l’Université de Paris, vice-président de la Fondation des Alliances françaises, membre de l’Académie royale de Belgique.

Un point constitutionnel

Les préfaciers rappellent que si, certes, l’article 2 de notre constitution, ajouté en 1992 dit que « La langue de la République est le français », il convient de lire cela avec attention car cela ne veut pas dire que « le français est la langue de la République », de manière exclusive :

« Très subtile valeur de la différence entre sujet et prédicat : le prédicat est important, mais il peut y en avoir d’autres[…] Le français n’est jamais qu’un prédicat du sujet « la langue de la République ». C’est un prédicat essentiel, mais certainement pas le seul possible. Bref, il n’a rien d’exclusif. »

Ils ajoutent que ce pays « qui se rêvait monolingue » est en fait riche de la diversité de son plurilinguisme. Il est plus que temps d’admettre – et partant d’enseigner – que « notre nation est forte de sa diversité, et au premier chef de ses idiomes. » Idiomes qui s’expriment le mieux à travers leurs littératures. Depuis le Moyen Âge et jusqu’au XXIe siècle, des écrivaines et écrivains pensent et rédigent dans d’autres langues que le français, révélant une diversité culturelle injustement absente des programmes scolaires. Florilangues ne se limite pas à la métropole, mais comprend aussi des auteurs employant les langues des « Outre-mer » – ce qui constitue une innovation.

L’ouvrage est paru chez un éditeur indépendant, L’aucèu libre, qui s’est d’abord fait connaitre, il y a longtemps déjà, par ses publications en provençal, et qui depuis lors n’a jamais renoncé à œuvrer pour nos langues minorisées.

Liste des auteur.e.s

Sebastian Brant, Nathan Katz, André Weckmann, Jean Etxepare, Bernardo Atxaga, Itxaro Borda, Théodore Hersart de La Villemarqué, Pierre-Jakez Hélias, Goulc’han Kervella, Josep Sebastià Pons, Jordi Pere Cerdà, Renada-Laura Portet, Ghjacumu Thiers, Ghjacumu Fusina, Lucia Santucci, Sonny Rupaire, Élie Stephenson, Raphaël Confiant, Axel Gauvin, Christian-Pierre Ghillebaert, Alexandre Burane Trimari, Côtis-Capel, Jaufré Rudel, Belaud de la Belaudièra, Frederi Mistral, Joan Bodon, Bernat Manciet, Max Roqueta, Mas-Felipe Delavouët, Marcela Delpastre, Mauricienne Fortino, Alexandre Desrousseaux, Pierre Garnier, Renée Gence, Henri Hiro.

Littérature d’Alsace

J’ai très modestement participé au chapitre concernant la littérature alsacienne. Le groupe piloté par Daniel Muringer était encore composé de feu Jean-Paul Sorg. Nous avions travaillé sur cinq textes mais il n’en fallait que trois. Pour les trois retenus, il y a, d’une part, un extrait de la Nef des fous de Sebastian Brant (1458-1521), le chapitre intitulé Des richesses inutiles. Brant y dénonce autant la folie de l’acquisition superflue de richesses que la considération indue qu’elles suscitent dans l’entourage de ceux qui les détiennent, au détriment des pauvres, des sages et des instruits. On trouvera, d’autre part, un extrait de la pièce de Nathan Katz (1892-1981), Annele Balthazar. Dans l’extrait de la tirade finale, son amoureux, Doni, s’en prend à ceux qui ont accusé Annele d’être possédée, puis imagine un monde plus juste et plus libre. Enfin, André Weckmann (1924-2012) décrit dans Le cortège, « un monde étrange qui [lui] semblait vivre en vase clos, en tout cas déconnecté de la réalité alsacienne ». Deux autres textes avaient été proposés. D’Albert Schweitzer d’une part, un extrait de son autobiographie dans lequel il écrit : « C’est l’allemand qui est ma langue maternelle, pour la raison qu’est allemand le dialecte alsacien dans lequel s’enracine mon parler ». (A. Schweitzer : Ma vie et ma pensée. Traduction : Jean-Paul Sorg. Éditions AISL. Gunsbach 2017. P. 87). De René Schickele, d’autre part, un extrait de Rundreise des fröhlichen Christenmenschen dans lequel il décrit le Rhin comme le pli d’un livre ouvert, dont une page se trouve sur la rive gauche et l’autre sur la rive droite du fleuve.

Je vous propose ci-dessous le texte introductif sur l’Alsace, non seulement parce que nous sommes sur le SauteRhin, mais aussi à titre d’exemple de la manière dont le florilège est présenté. Toutes les langues sont ainsi introduites sous ce format. J’y ajoute des liens vers les auteurs abordés sur mon blog :

« La littérature alsacienne en deux, trois langues

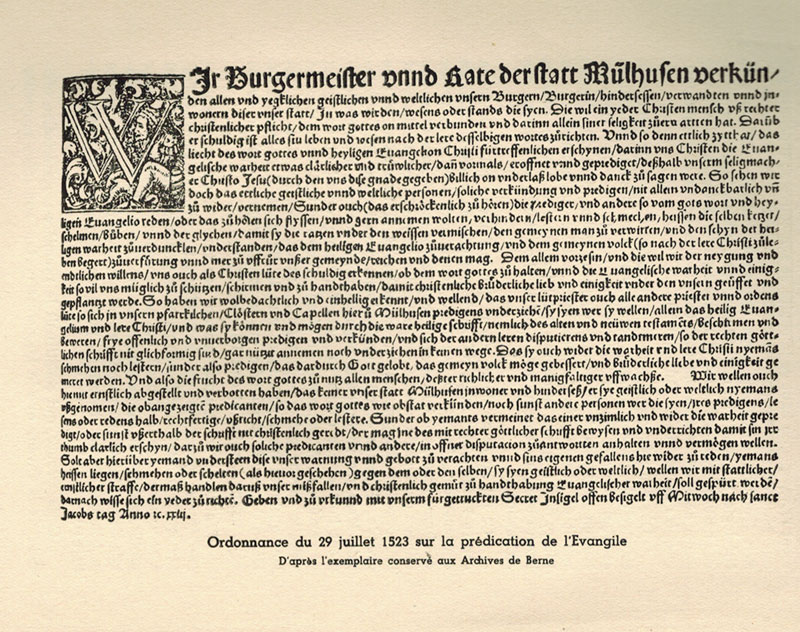

La littérature alsacienne a ceci de particulier qu’elle s’exprime aujourd’hui tant dans la langue de Molière que dans celle de Goethe, ainsi que dans les différentes formes d’allemand dialectal (haut-alémanique, bas-alémanique, francique rhénan).Otfried von Weißenburg [Wissembourg] est le premier poète allemand à utiliser le tudesque (deutsch, soit « langue du peuple »), achevant son Evangelienbuch en francique rhénan vers 870. Au XIIe siècle, Herrade de Landsberg utilise le latin pour son Hortus deliciarum. Reinmar von Hagenau, à la fin du XIIe siècle, chante les amours malheureuses, suivi par quantité d’autres Minnesänger, dont Gottfried von Strassburg qui laisse son Tristan inachevé.

La Renaissance est l’âge d’or de la littérature alsacienne, la vallée supérieure du Rhin devenant un, sinon le centre de la vie culturelle allemande. En témoigne le rayonnement de la bibliothèque humaniste de Sélestat. C’est l’heure de Sebastian Brant, de Beatus Rhenanus (ami d’Erasme), de Georg Wickram et de Johann Fischart avec son Gargantua. Le siècle suivant est moins florissant : les ravages de la guerre de Trente ans (1618 – 1648), la brutale annexion du « beau jardin » par Louis XIV en 1648 n’y sont pas étrangers. On retiendra pourtant de Moscherosch (1601 – 1669) Unter Räubern (Soldatenleben). Le XIXe siècle marque dès son début un tournant avec l’utilisation de l’allemand dialectal, ou, si l’on préfère, de l’alsacien. Goethe collecte en Alsace des chants populaires ; comme ailleurs, l’intérêt pour la langue du peuple grandit. Georges-Daniel Arnold a recours au dialecte pour sa comédie bourgeoise qui inaugure le théâtre régional. Poètes, dramaturges et folkloristes, les Stöber père, Ehrenfried (« ma lyre est allemande, mon épée est française »), et ses deux fils poètes, Auguste (un Grimm alsacien) et Adolphe, occupent une place de choix dans la période. En 1898, Gustave Stosskopf écrit D’r Herr Maire, chef-d’œuvre du théâtre alsacien alors en plein essor. La pièce est l’objet, en 1939, du seul film « français » en alsacien.

À la veille de la Première Guerre mondiale, le cercle artistique co-fondé par René Schickele veut promouvoir une littérature à la fois alsacienne et européenne. Autre pacifiste et écrivain, le médecin humanitaire Albert Schweitzer.

Le siècle et demi qui nous précède voit apparaitre une myriade d’auteurs qu’il serait juste mais impossible de tous citer : Nathan Katz, Emile Storck, Claude Vigée, Marie Hart, Lina Ritter… Ces deux dernières sont expulsées de leur Heimat en 1918 parce que mariées à des Allemands. Beaucoup d’écrivains, parmi les plus récents, à l’instar d’André Weckmann, s’expriment dans les trois modes, le français à l’occasion, l’allemand standard en général pour la prose, parfois pour la poésie, qui est le plus souvent en « dialecte », celui-ci demeurant l’apanage de l’écriture dramatique. Bien qu’aujourd’hui le dialecte alsacien ne soit plus une langue populaire parlée massivement, des poètes inspirés continuent à l’écrire.

Pourquoi un Rhin nous sépare-t-il ?

Pour que nous puissions montrer

Comment construire des ponts. (Lina Ritter). »

La dernière citation est un haïku alsacien. En voici l’original, en alémanique :

« Worum trennt uns e Rhi ?

Àss mir zeige chenne,

wie me Brucke bäut »

Il a été question de la version filmée d’une pièce de Gustave Stosskopf. J’en profite pour rappeler que celle-ci connait une nouvelle vie.

Le film, D’r Herr Maire, (M’sieur l’maire), a été produit en 1939 par Félix Beaujon et réalisé par Jacques Séverac. Il vient d’être restauré, est disponible en DVD et a commencé à être présenté dans quelques salles de cinéma de la région.

Le DreylandDichterweg. Le sentier des poètes des trois pays

La littérature d’Alsace fait partie des langues régionales qui partagent une langue dépassant les frontières.

Source

Le Sentier des Poètes des Trois pays, dont on vient de fêter, à Huningue, les dix ans d’existence, a pour singularité de traverser et relier avec la poésie trois pays le long d’un fleuve commun. Il se compose de 30 poèmes en version bilingue d’autrices et d’auteurs de trois nationalités répartis sur 27 stations et 3 panneaux d’information, de part et d’autre du Rhin. Un QR code permet de les écouter. Depuis le haut Moyen Âge, l’Alsace, le pays de Bade du Sud et Bâle sont étroitement liés par leur langue commune, l’alémanique. Le projet de ce sentier, qui a eu pour modèle celui de Munster, en Alsace, a été initié, conçu et développé par l’Association culturelle Elsass-Freunde Basel (les Amis de l’Alsace à Bâle). Sa réalisation a été menée en étroite collaboration avec les communes de Weil am Rhein, Huningue ainsi que le Département des travaux publics et des transports de Bâle-Ville, et grâce à leurs financements.

Nathan Katz et Mistral

Avant de quitter les rives du Rhin vers d’autres contrées et langues, une remarque encore. Nathan Katz a traduit, entre bien d’autres, de Frederi Mistral : La coutigo, une chanson dialoguée entre une mère et son fils. Il a de même transposé en alémanique, du catalan, l’espagnol Joan Maragall ( La légende de Jean Gari à Monserrat et La vache aveugle). J’ignore s’il existe dans les autres langues de tels échanges. Il serait intéressant de le savoir. Fréderic Mistral, rappelons-le, a obtenu le Prix Nobel de littérature en 1904 pour son œuvre en langue d’oc. Il figure bien entendu dans l’ouvrage dont-il est question et vers lequel nous faisons retour avec son célèbre Mireille (Mirèio)

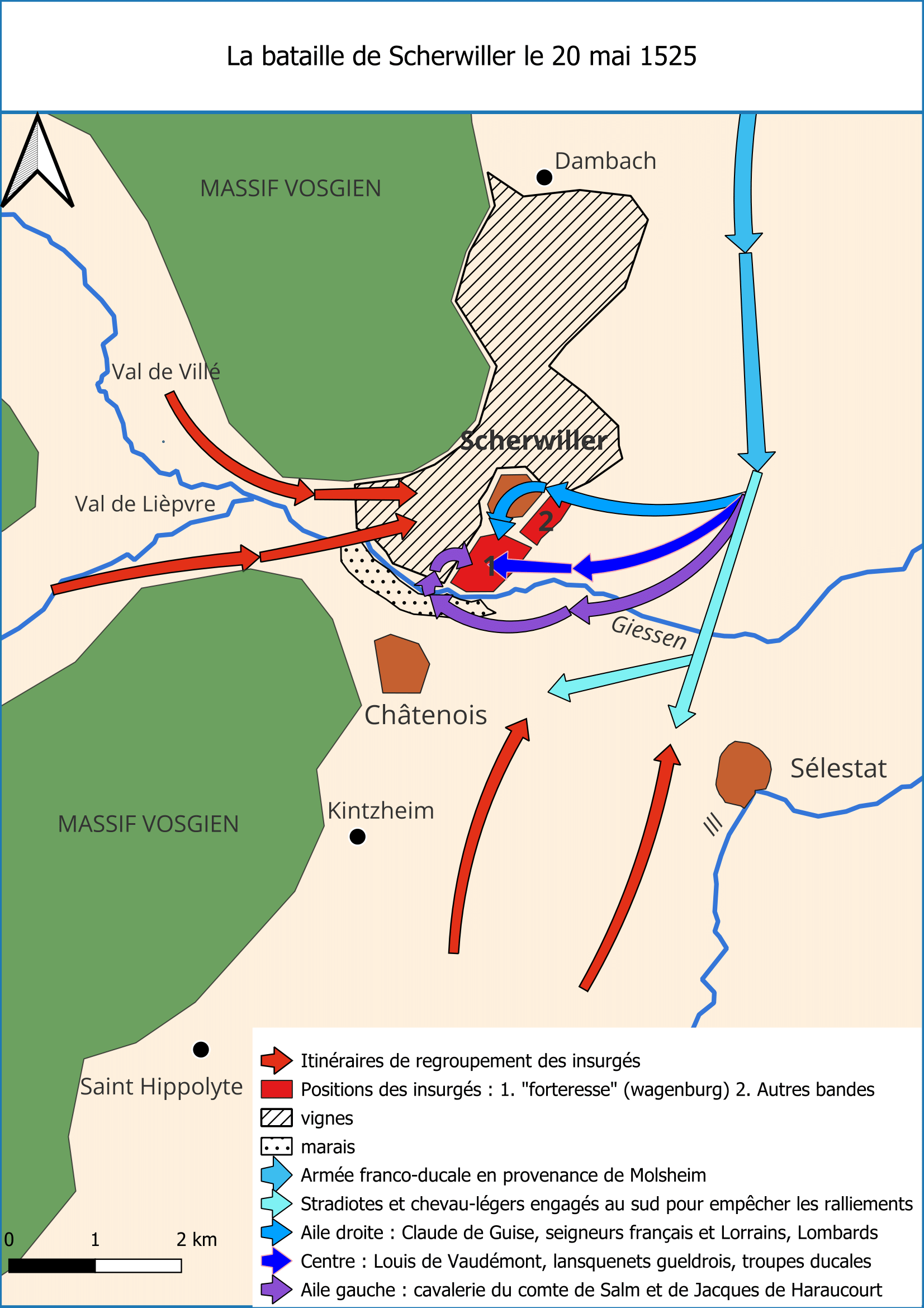

Chansons

Puisqu’il vient d’être question de chanson, je signale que dans mon feuilleton sur la « Guerre des paysans », j’avais mis en avant deux chansons particulières datant de l’époque des évènements : celle du Rosemont, en langue comtoise et celle dite des Armagnacs sur le siège de Wattwiller, en langue germanique. Dans Florilangue, on trouvera L’canchon dormoire, plus connue sous le nom de « P’tit Quinquin ». Elle a été publiée en 1853. Devenue « l’hymne du nord », elle est l’œuvre de Alexandre Desrousseaux, et figure dans le florilège dans une traduction inédite d’Olivier Engelaere. Le début est bien connu : Dors min p’tit quinquin / Min p’tit pouchin / Min gros rojin /Te m’ f ’ras du chagrin / Si te n’dors point qu’à d’main. Mais connait-on le texte intégral ? Il ne manque pas d’une certaine épaisseur.

Restons au picard. Je ne résiste pas au plaisir de partager ce poème spatial de Pierre Garnier sur les différentes prononciations du pivert ou pic-vert, en idiomes picards.

Langues régionales ?

J’ai évoqué la dimension transnationale de l’alémanique. Cela s’applique bien entendu à d’autres langues. L’introduction précise que la notion de « langue régionale » est sujette à discussion.

« D’une part, la situation spatiale, souvent réelle, à laquelle l’appellation veut renvoyer ne correspond pas toujours à la réalité géographique et linguistique. Par exemple, l’occitan-langue d’oc s’étend non seulement sur plus d’une trentaine de départements français mais également jusqu’au nord de l’Espagne et sur une partie des Alpes italiennes. Il constitue donc une langue transrégionale ou extrarégionale et même transnationale. Idem à une moindre échelle pour le picard et le flamand occidental, que n’arrête pas la frontière avec la Belgique, ou encore pour le corse, parlé en Gallura, au nord de la Sardaigne, tandis que basque et catalan enjambent sans difficulté la frontière sud-ouest de la France. D’autre part, on peut se demander si la dénomination ne masque pas une volonté de minoration de la présence de ces langues »

Préoccupations partagées

L’interdit des idiomes maternels à l’école fait partie des préoccupations partagées entre les différentes régions. Ainsi Pierre-Jakez Hélias écrit-il dans l’extrait publié de Cheval d’orgueil :

« nos parents, surtout les Rouges, redoublent la punition de l’instituteur quand il nous a surpris à parler breton dans un endroit où il ne le faut pas »

Bon, mes parents, qui étaient rouges, ne sévissaient pas mais avaient fait le choix de parler français avec moi. Comme entre eux ils parlaient le dialecte quand le sujet de leur conversation n’était pas censé m’intéresser, j’ai tout de même été attiré vers l’idiome de mes grands-parents. Je suis de la génération, il est chic de parler français, le dialecte nous était interdit dans la cour de récréation.

Que de langues !

Je n’entrerai pas dans le détail de toutes les langues. Je me contenterai de pointer quelques généralités. A commencer par leur nombre impressionnant. Si l’on sort de l’hexagone, et c’est l’originalité de Florilangues de le faire, on constate, dans ce que l’on appelle aujourd’hui les départements et régions d’Outre-mer et collectivités d’Outre-mer (DROM-COM), une floraison linguistique encore plus foisonnante.

« La richesse linguistique des territoires d’Outre-mer français est particulièrement multiple et complexe : plus de 50 langues y sont répertoriées par le Ministère de la Culture. Pour simplifier grandement, disons qu’elles correspondent à deux catégories principales : d’une part les langues des populations autochtones, là où elles n’ont pas été exterminées (principalement dans les territoires du Pacifique et la Guyane française) ; d’autre part les créoles à base française, qui comptent le plus grand nombre de locuteurs (aux Antilles, en Guyane et à La Réunion). Il faut y ajouter des langues de type créole avec une autre base que le français (en Guyane) et le cas particulier des deux langues de Mayotte. Enfin, notons que d’autres langues ne figurent pas dans la liste ministérielle : par exemple les langues d’origine indienne, en particulier le tamoul et le gujarati, apportées par deux vagues d’immigration dans la deuxième moitié du XIXe siècle à La Réunion. Ces langues ultra-marines, majoritairement, n’ont pas de production littéraire écrite, alors que les traditions orales, éventuellement chantées, s’imposent comme une constante. Elles constituent d’ailleurs une des sources d’inspiration pour l’écrit, en particulier dans le Pacifique ».

L’archipel aux trente langues

Le nengone, ou p’ene nengone, est la langue kanak parlée dans l’île de Maré.

«L’archipel néo-calédonien, à lui seul, rassemble presque une trentaine de langues, répertoriées par le ministère français de la culture, soit 40 % de la diversité linguistique française ! L’Académie des langues kanak reconnaît quant à elle 40 langues. Toutes sont marquées par des traditions de culture orale plus ou moins abondamment conservées, mais n’ont que rarement produit des publications littéraires écrites, si ce n’est des transcriptions de contes traditionnels. La plupart des écrivains ont en effet choisi généralement la langue française, comme ailleurs dans les anciennes colonies devenues territoires d’outre-mer. Cependant, le début du XXIe siècle a vu l’éclosion d’auteurs qui ont résolument opté pour leur langue ancestrale et maternelle ».

Guyane

Le Rapport sur les langues de la France de Bernard Cerquiglini (1999) cite pour la Guyane douze langues qui répondent aux critères de citoyenneté et de territorialisation posés par la Charte européenne des langues régionales et minoritaires de 1992. Cette dernière n’a toujours pas été ratifiée par la France. Outre le créole guyanais, à base lexicale française, on trouve six langues amérindiennes, appartenant à trois familles : caribe, avec le kali’na (autrefois appelé galibi) et le wayana ; tupi-guarani, avec le teko (ou émerillon) et le wayampi (ou wayãpi), et arawak, avec le palikur (ou parikwaki) et l’arawak-lokono. On trouve aussi quatre langues bushinenge, dont trois à base lexicale anglaise, très proches entre elles : l’aluku (ou boni), le ndyuka, le pamaka (ou paramaka), et un à base lexicale anglo-portugaise, le saamaka (ou saramaka). Les locuteurs de bushinenge sont les descendants des Marrons du Surinam, esclaves révoltés qui ont fui les plantations et développé dans la forêt amazonienne des cultures afrodescendantes originales. Toutes ces langues, sauf le teko, sont transfrontalières, avec le Brésil ou le Surinam. Enfin le rapport cite aussi le hmong, dont les locuteurs, originaires du Laos, ont fondé deux villages en 1977 et 1978.

« Ces langues sont dépourvues de tradition écrite ancienne. […] Depuis les années 1970, on assiste à une floraison de publications, en langue locale ou en bilingue, de contes, récits et mythes de tradition orale ».

Tahiti

J’ai commencé par l’Alsace ce qui respecte aussi l’ordre alphabétique. Dans le même ordre d’idée je terminerai ce compte rendu qui ne se veut pas exhaustif, loin de là, par Tahiti. Cela nous permettra en outre d’aborder une thématique écologique en lien avec la perte des savoirs traditionnels. Voici donc un poème en vers libres de Henri Hiro (1944 – 1990), extrait du recueil bilingue Pehepehe i taù nūnaa / Message poétique

« Avec ironie, l’auteur transforme une activité quotidienne comme la pêche en une situation absurde et comique, mettant en évidence la méconnaissance alarmante des savoirs écosystémiques traditionnels chez les jeunes polynésiens. Ce problème est étroitement lié aux répercussions de la colonisation et de la mondialisation ».

J’espère avoir un peu éveillé votre curiosité. Il ne vous reste plus qu’à commander Florilangues chez votre libraire (le n° ISBN est le 978-2-917111-98-7), à le lire et le faire lire. Son but est que partout sur le territoire de la République, que l’on soit martiniquais ou occitan, alsacien, kanak ou catalan, parisien, lillois, marseillais, dyonisien ou bastiais, sans enfermement régionaliste, on puisse avoir accès à des textes et des auteurs qui ont tous quelque chose de précieux à nous donner. Souhaitons aussi qu’il serve à la formation de nos hommes et femmes politiques présents et futurs.